Les premières innovations d’IA pour la protection des yeux et la détection de Deepfake

HONOR a dévoilé deux innovations de pointe en matière d'IA lors de la MWC Shanghai 2024, marquant une avancée significative dans la protection de l'utilisateur et la détection des fraudes. Ces technologies, axées sur l'IA embarquée, promettent de révolutionner l'expérience utilisateur.

Lors de la conférence intitulée « La Synergie Homme-IA : Les Dispositifs Intelligents au Service des Personnes », HONOR a présenté ses nouvelles technologies IA Defocus Eye Protection et IA Deepfake Detection. George Zhao, CEO de HONOR Device Co., Ltd., a souligné l’importance de l’IA embarquée : « L’IA révolutionne nos vies et pousse l’industrie des smartphones vers l’avant, mais l’IA basée sur le cloud n’est qu’une partie de l’équation. L’IA embarquée, qui fonctionne sur les smartphones et nous comprend mieux que tout autre dispositif, est en position unique pour offrir des services adaptés à nos préférences.

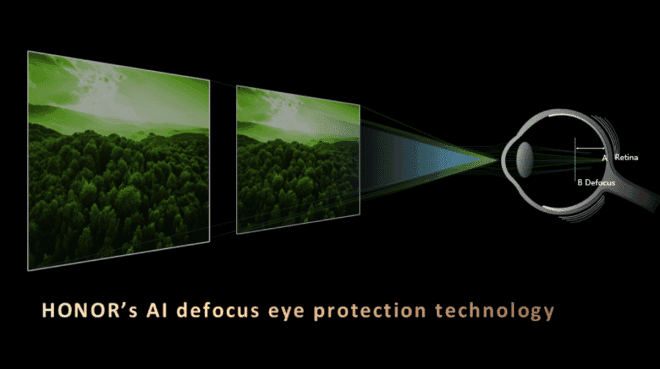

Évolution de la technologie de protection des yeux

Reconnaissant l’augmentation mondiale des cas de myopie due à l’utilisation prolongée des écrans, HONOR a lancé l’IA Defocus Eye Protection. Cette technologie utilise l’IA pour simuler des lunettes de défocalisation sur l’écran du smartphone, reproduisant un effet qui aide à maintenir une vision centrale claire et à ralentir le processus d’élongation de l’œil. Les bénéfices sont impressionnants :

- Diminution de la myopie transitoire de 13 degrés en moyenne après 25 minutes de lecture.

- Certains utilisateurs ont constaté une réduction maximale de 75 degrés.

Ces résultats montrent un potentiel réel pour non seulement prévenir, mais aussi soulager les symptômes de la myopie.

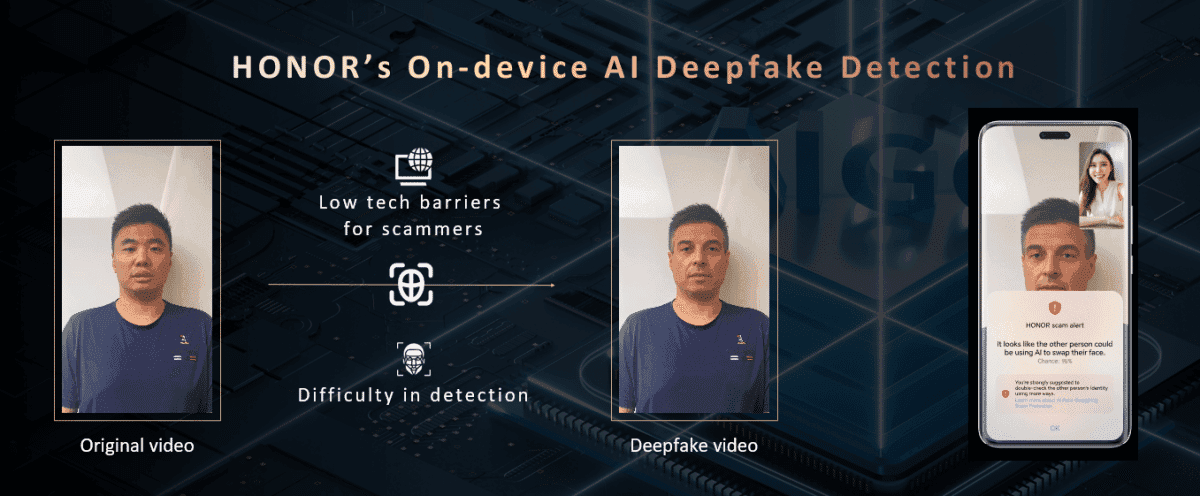

Réduction de la fraude avec la détection d’IA Deepfake

En réponse aux risques posés par les technologies de deepfake basées sur le cloud, HONOR a introduit l’IA Deepfake Detection. Cette technologie analyse des informations image par image telles que le contact visuel, l’éclairage, la clarté de l’image et la lecture vidéo pour identifier des anomalies imperceptibles à l’œil humain. Les capacités de cette IA incluent :

- Examen rapide des vidéos et images grâce à un vaste ensemble de données sur les escroqueries en ligne.

- Identification, filtrage et comparaison en moins de trois secondes.

- Avertissement instantané en cas de détection de contenu synthétique ou altéré, protégeant ainsi les utilisateurs contre les arnaques potentielles.

En combinant ces innovations, HONOR réaffirme son engagement envers une technologie centrée sur l’humain, mettant en avant des solutions qui non seulement améliorent la vie quotidienne mais protègent également les utilisateurs de manière proactive.

À travers ces développements, HONOR démontre une compréhension profonde des besoins actuels des utilisateurs. L’accent mis sur l’IA embarquée offre des avantages tangibles en matière de confidentialité et de performance. Il est clair que cette approche pourrait définir les normes futures pour les appareils intelligents, en plaçant la sécurité et le bien-être des utilisateurs au cœur des préoccupations technologiques. Voilà un excellent exemple de l’apport de l’IA dans nos smartphones !

Les effets néfastes des Deepfakes

Les deepfakes continuent de représenter une menace croissante avec des implications sévères pour la sécurité, la réputation et la confiance en ligne. Voici quelques chiffres récents pour 2023 et 2024 qui illustrent l’ampleur du problème :

Escroqueries et fraudes

- En 2023, le FBI a rapporté une augmentation de 40% des escroqueries impliquant des deepfakes par rapport à l’année précédente, avec des pertes estimées à plus de 250 millions de dollars pour les entreprises et les individus.

- Des deepfakes vocaux ont été utilisés dans plusieurs incidents majeurs pour usurper l’identité de dirigeants d’entreprise, entraînant des transferts de fonds frauduleux.

Désinformation et manipulation politique

- Selon une étude de Deeptrace en 2024, le nombre de vidéos deepfake en ligne a dépassé les 50 000, dont une partie substantielle est utilisée pour diffuser de fausses informations à des fins politiques.

- Les élections de 2024 dans plusieurs pays, dont les États-Unis et l’Inde, ont été marquées par l’utilisation de deepfakes pour manipuler l’opinion publique et semer la confusion.

Atteinte à la réputation et cyberharcèlement

- Une enquête de Sensity AI en 2023 a révélé que 92% des deepfakes en ligne étaient de nature pornographique, visant souvent à discréditer et harceler des individus, principalement des femmes.

- Les cas de cyberharcèlement utilisant des deepfakes ont augmenté de 35% en 2023, affectant la santé mentale et le bien-être des victimes.

Impacts psychologiques et sociaux

- Une étude menée par l’Université de Cambridge en 2024 a montré que les victimes de deepfakes souffrent de niveaux élevés de stress, d’anxiété et de dépression, avec des impacts durables sur leur vie personnelle et professionnelle.

- Les deepfakes ont également contribué à une méfiance accrue envers les contenus vidéo en ligne, affectant la perception publique de la vérité et de l’authenticité.