Combien d’entreprises sont victimes de la fraude par deepfake ?

L'intelligence artificielle, sujet de controverse pour diverses raisons comme la gestion des droits d'auteur, la consommation d'énergie, les problèmes de confidentialité, et la fourniture parfois erronée de réponses par des chatbots comme ChatGPT, suscite de nombreuses questions. L'augmentation des fraudes par deepfake est une source d'inquiétude majeure. Quel sera son impact futur ?

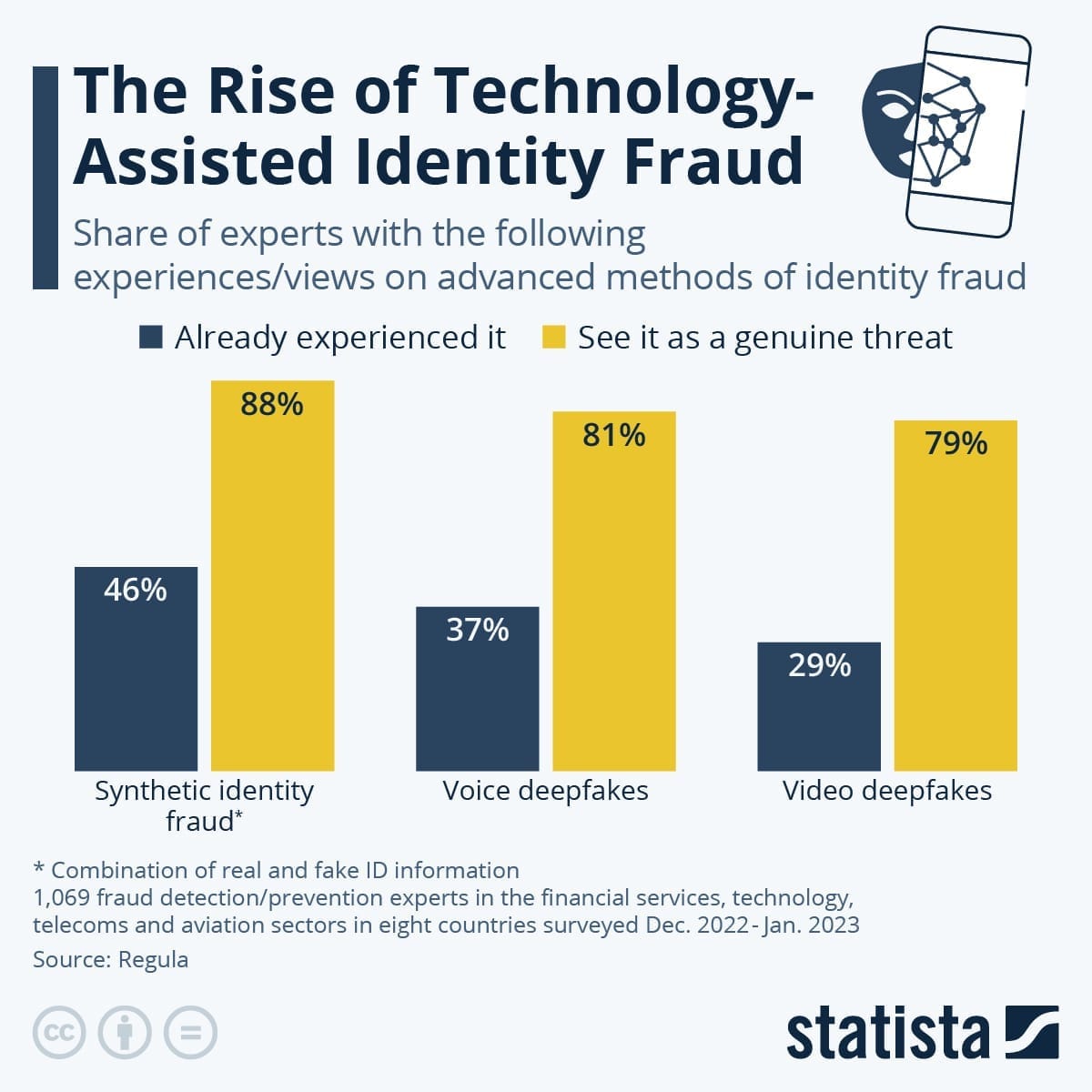

D’après une enquête menée par Regula, spécialiste de la vérification d’identité, 37 % des entreprises ont été victimes de fraude vocale et 29 % de fraude vidéo impliquant des deepfakes sur smartphones. Il est important de noter que ces chiffres ne représentent probablement que la pointe de l’iceberg, car de nombreuses entreprises ne signalent pas ce type de fraude. Il existe un consensus parmi les défenseurs et les critiques : la technologie de l’Intelligence Artificielle (IA) se répand à tous les niveaux de notre vie numérique, du monde des affaires à la politique, en passant par la culture. Avec cette proliferation, une utilisation illicite de l’IA a été notée : celle des deepfakes.

Des deepfakes pour désinformer et frauder

Les deepfakes sont des vidéos ou des audios générés par l’IA qui se font passer pour des personnalités, comme des célébrités ou des politiciens, dans le but de « répandre des informations erronées ou trompeuses ou de frauder les consommateurs ». Les entreprises du monde entier commencent déjà à ressentir l’impact de ce type de contenu.

Une menace croissante pour les entreprises

Une enquête menée par le fournisseur d’identification Regula auprès de plus de 1000 experts en détection et prévention de la fraude, notamment aux États-Unis, au Royaume-Uni, en France et en Allemagne, a révélé que de nombreuses entreprises avaient été victimes de l’un des trois types de fraude identitaire avancée. En effet, 46% des répondants ont signalé des cas de fraude identitaire synthétique, où une combinaison de véritables et de faux éléments d’identité, a été utilisée. Quant aux deepfakes vocaux utilisés, 37% ont noté leur utilisation. Les deepfakes vidéo sont moins courants, avec seulement 29% des répondants qui en ont été victimes. Cependant, cela pourrait évoluer rapidement avec le développement de la technologie générative des IA, tels que l’outil Sora d’OpenAI.

En tout cas les entreprises peuvent prendre un certain nombre de mesures pour se protéger contre la fraude par deepfake, notamment :

- Sensibiliser les employés aux dangers des deepfakes et à la manière de les identifier.

- Mettre en place des contrôles de sécurité solides, tels que l’authentification à deux facteurs et la vérification biométrique.

- Utiliser des logiciels de détection de deepfakes.

- Surveiller les réseaux sociaux et autres plateformes en ligne pour détecter les deepfakes qui pourraient nuire à l’entreprise.

L’inquiétude grandissante

Cette préoccupation est d’ailleurs partagée par 80 à 90% des experts sondés qui considèrent ces trois méthodes de fraude comme une véritable menace. « Les fausses identités générées par l’IA peuvent être difficiles à détecter pour les humains, à moins qu’ils ne soient spécialement formés à le faire », prévient Ihar Kliashchou, Directeur technique chez Regula.